組合が日本IBMとキンドリルジャパンを相手取って東京都労働委員会に申し立てているAI不当労働行為事件の証人尋問が2022年5月16日に行われました。これにより、会社によって無責任な状態で賃金査定に使われているワトソンAIの危険な運用実態が明らかになりました。

会社側証人として証言した元人事のラインですらワトソンAIが扱っているデータの全貌を知らず、さらにワトソンAIが提示する内容は日本の就業規則や格付規程と合っていないことも明らかになりました。

AIの問題点

改めて賃金査定にAIを使う際の問題点を以下にまとめます。

①プライバシー侵害問題

AIが収集する情報の中に人事考課において考慮すべきでない情報(プライバシー情報)が含まれるのか。GDPR(EU一般データ保護規則)の観点では当該個人がコントロールできなければなりません。

②公平性・差別の問題

AIが学習の段階で用いられるデータにバイアスが含まれ、それがAIのアウトプットに反映され、結果として不当に差別される恐れがあります。

③ブラックボックス問題

ビッグデータとディープラーニングの結果生成された結果は説明できないため、査定結果の説明ができなくなります。

④自動化バイアスの問題

コンピュータが出す結果に人間の判断が意図せず左右される傾向があります。

AIを用いた査定実態

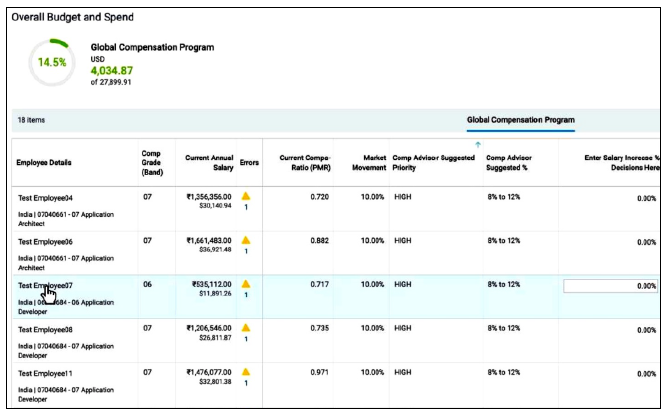

この会社には賃金テーブルのような規定が無いため、個別従業員の賃上げ額は直接の上司が決定します。上図は上司が部下の賃上げ金額を決定する際に入力する実際の画面です。

一番左上にこの上司が持っている賃上げ予算額が表示されています。その下に部下のリストが表示されています。部下の表示順序は、ワトソンAIの提案する賃上げ率に応じて3つのランク、HIGH、MID、LOWが勝手に決められ、その順番で表示されます。

上司がそれぞれの部下の昇給率を決定し入力すると、自動的に昇給額が計算されて表示され、その上司の持ち予算が減っていく仕組みです。

ここに重要なカラクリがあります。自動化バイアスにより、上司が意図せずにリストの上位に表示される部下から順番に賃上げ額を決定していってしまうことは容易に想像できます。しかも、会社が付与する予算は限られているため、AIが提案する賃上げ率通りに賃上げしてしまうとすぐに予算が尽きてしまいます。

この会社では一人の上司が30人の部下を持つこともめずらしくありません。そうなれば、リストの下位に表示された部下の昇給は無くなると考えたほうが自然です。しかし、部下の側から見れば、自分がリストのどの位置に表示されるかは、まったく知らされないですし、その決定方法すら日本の就業規則や格付規定と合っていない実態が明らかとなりました。

違法な状態を変えよう

現状ではAIが収集しているデータ項目が何であるか不明で、仮に間違っていてもそれを検証する手段がありません。しかも大前提となっている各部署への予算配分はブラックボックスのままとなっています。これでは、労働基準法第二条に定める労働条件の労使対等決定原則に反しています。組合に結集し、違法な状態を変えましょう。